在神经网络的推理过程中,我们默认是将pytorch的tensor的精度指定为单精度的float32,但是在有些时候不管是float16还是float32,在训练模型的时候都会导致精度丢失,从而引发训练效果的损失。那么pytorch怎么使用float64训练呢?接下来这篇文章告诉你。

首先我们要知道,pytorch默认使用单精度float32训练模型,

原因在于:

使用float16训练模型,模型效果会有损失,而使用double(float64)会有2倍的内存压力,且不会带来太多的精度提升。

本人,最近遇到需要使用double数据类型训练模型的情况,具体实现需要把模型的权重参数数据类型和输入数据类型全部设置为torch.float64即可。

可使用torch的一个函数,轻松地把模型参数转化为float64

torch.set_default_dtype(torch.float64)输入类型可使用

tensor.type(torch.float64)补充:float32和float64的本质区别

首先我们需要知道何为bits和bytes?

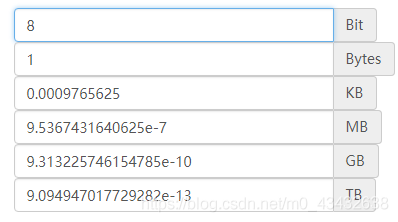

bits:名为位数bytes:为字节简单的数就是MB和G的关系!

那么8bits=1bytes,下面是各个单位的相互转化!

那么float32和float64有什么区别呢?

数位的区别一个在内存中占分别32和64个bits,也就是4bytes或8bytes数位越高浮点数的精度越高它会影响深度学习计算效率?

float64占用的内存是float32的两倍,是float16的4倍;

比如对于CIFAR10数据集,如果采用float64来表示,需要60000*32*32*3*8/1024**3=1.4G,光把数据集调入内存就需要1.4G;

如果采用float32,只需要0.7G,如果采用float16,只需要0.35G左右;

占用内存的多少,会对系统运行效率有严重影响;(因此数据集文件都是采用uint8来存在数据,保持文件最小)

小结

在了解了float32和float64有什么区别之后,相信各位读者心中已经知道应该如何选择训练模型时要使用哪种精度了。以上为个人经验,希望能给大家一个参考,也希望大家多多支持W3Cschool。

免费AI编程助手

免费AI编程助手